# 容器化监控与日志管理解决方案: Prometheus和EFK详解

## 引言:容器化环境下的监控挑战

在云原生时代,容器化技术已成为现代应用部署的**标准范式**。随着容器编排平台如Kubernetes(K8s)的普及,传统的监控和日志管理方案面临前所未有的挑战。容器环境的**动态特性**(如IP变化、短暂生命周期)和**高密度部署**特性,使得传统的监控工具难以适应。我们亟需专门针对容器环境设计的监控和日志解决方案。Prometheus作为CNCF毕业项目,已成为容器监控的事实标准,而EFK(Elasticsearch, Fluentd, Kibana)栈则提供了强大的日志管理能力。本文将深入解析这两大技术栈的核心原理、部署实践及整合方案,助力我们构建完善的容器化可观测性体系。

---

## 1. 容器化监控的挑战与Prometheus的解决方案

### 1.1 容器监控的核心挑战

容器化环境引入了传统物理机和虚拟机环境中不存在的特殊监控挑战:

- **动态服务发现**:容器IP地址随调度不断变化

- **短暂生命周期**:容器可能仅存在几分钟甚至几秒

- **高密度部署**:单节点运行数十个容器实例

- **微服务依赖**:复杂的服务调用链难以追踪

- **多维度指标**:需要同时监控容器、应用和基础设施

根据CNCF 2023调查报告,**78%的云原生环境**使用Kubernetes,其中**监控复杂度**被列为第二大运维挑战。传统基于静态IP的监控方案在容器环境中效率低下,无法适应动态伸缩需求。

### 1.2 Prometheus的核心理念

Prometheus通过以下创新设计解决容器监控难题:

- **多维数据模型**:指标通过键值对标签标识,支持灵活查询

- **主动拉取(Pull)模式**:服务定期暴露指标,Prometheus主动采集

- **强大的服务发现**:原生支持Kubernetes、Consul等服务发现机制

- **内置时序数据库**:高效存储时间序列数据

- **PromQL查询语言**:支持复杂的数据聚合和分析

```yaml

# Prometheus配置示例(Kubernetes服务发现)

scrape_configs:

- job_name: 'kubernetes-pods'

kubernetes_sd_configs:

- role: pod

relabel_configs:

- source_labels: [__meta_kubernetes_pod_annotation_prometheus_io_scrape]

action: keep

regex: true

- source_labels: [__meta_kubernetes_pod_annotation_prometheus_io_path]

action: replace

target_label: __metrics_path__

regex: (.+)

```

此配置实现自动发现Kubernetes中所有带有`prometheus.io/scrape=true`注解的Pod,并采集其监控指标。

---

## 2. Prometheus核心架构详解

### 2.1 系统架构组件

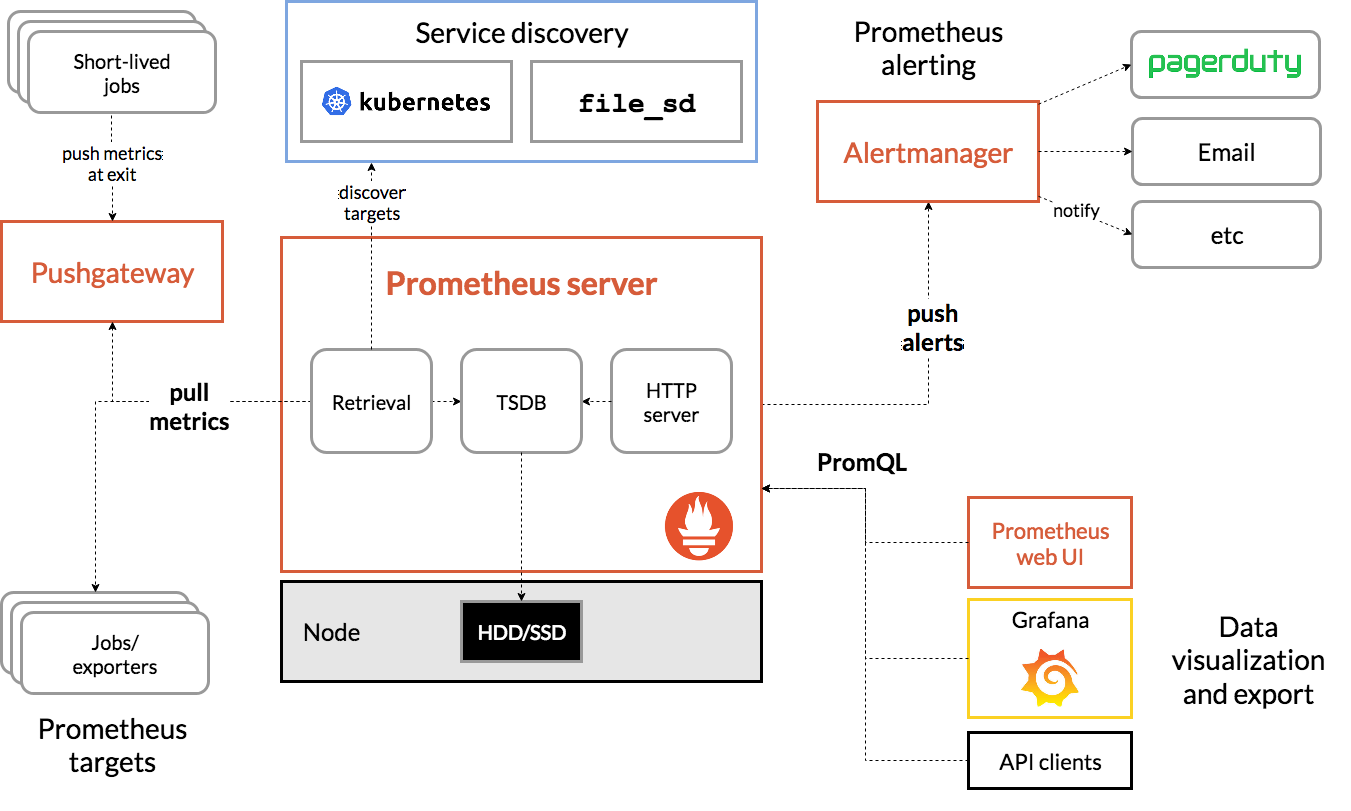

Prometheus生态系统由多个协同工作的组件构成:

- **Prometheus Server**:核心服务,负责指标抓取、存储和查询

- **Exporters**:指标暴露器(如Node Exporter、MySQL Exporter)

- **Pushgateway**:支持短生命周期作业的指标推送

- **Alertmanager**:告警路由与通知管理

- **Client Libraries**:多种语言的SDK(Go, Java, Python等)

*图:Prometheus官方架构示意图*

### 2.2 数据模型与存储机制

Prometheus采用多维数据模型存储时间序列数据:

```python

# 指标格式示例

http_requests_total{method="POST", handler="/api/v1/users", status="200"} 2453

http_requests_total{method="GET", handler="/api/v1/products", status="200"} 8762

```

关键概念:

- **Metric Name**:指标名称(如http_requests_total)

- **Labels**:键值对标签(method, handler等)

- **Sample**:特定时间点的数值(2453, 8762)

- **Timestamp**:数据点时间戳

数据存储采用自定义时序数据库,基于**TSDB(Time Series Database)**实现,数据按块存储(默认2小时块),并使用**WAL(Write-Ahead Log)**确保数据持久性。根据基准测试,单个Prometheus实例可处理**百万级时间序列**,压缩率可达原始数据的1.5%。

### 2.3 PromQL实战示例

PromQL是Prometheus的查询语言,支持复杂分析:

```sql

# 计算每秒HTTP请求率(5分钟窗口)

rate(http_requests_total[5m])

# 按状态码统计请求分布

sum by (status) (rate(http_requests_total[5m]))

# 预测磁盘空间耗尽时间

predict_linear(node_filesystem_free_bytes[1h], 4*3600) < 0

```

### 2.4 告警规则配置

Alertmanager处理告警通知的路由和分组:

```yaml

# alert.rules.yml

groups:

- name: node-alerts

rules:

- alert: HighNodeCPU

expr: 100 - (avg by(instance) (rate(node_cpu_seconds_total{mode="idle"}[5m])) * 100) > 80

for: 10m

labels:

severity: critical

annotations:

summary: "高CPU使用率 ({{ $labels.instance }})"

description: "CPU使用率超过80%持续10分钟"

```

---

## 3. EFK日志管理栈解析

### 3.1 EFK架构组成

EFK栈由三大核心组件构成分布式日志管理系统:

- **Fluentd**:统一日志收集层(数据收集/过滤/路由)

- **Elasticsearch**:分布式搜索与分析引擎(数据存储/索引)

- **Kibana**:可视化与日志分析平台(数据展示)

在容器环境中,Fluentd通过**DaemonSet形式部署**到每个节点,收集所有容器日志。根据Elastic公司2023年报告,EFK方案可处理**每日TB级日志量**,P99查询延迟低于500ms。

### 3.2 Fluentd核心配置

Fluentd使用插件架构,典型容器日志配置:

```xml

@type tail

path /var/log/containers/*.log

pos_file /var/log/fluentd-containers.log.pos

tag kubernetes.*

read_from_head true

@type json

time_format %Y-%m-%dT%H:%M:%S.%NZ

@type kubernetes_metadata

@type elasticsearch

host elasticsearch

port 9200

logstash_format true

logstash_prefix fluentd

```

此配置实现:

1. 跟踪容器日志文件变化(tail插件)

2. 提取Kubernetes元数据(Pod名称、命名空间等)

3. 输出到Elasticsearch并自动索引

### 3.3 Elasticsearch索引优化

针对日志场景的索引策略优化:

```json

PUT /fluentd-2023.11.11

{

"settings": {

"number_of_shards": 3,

"number_of_replicas": 1,

"refresh_interval": "30s"

},

"mappings": {

"properties": {

"@timestamp": { "type": "date" },

"message": { "type": "text" },

"kubernetes.pod_name": { "type": "keyword" }

}

}

}

```

最佳实践:

- 按日创建索引(fluentd-YYYY.MM.DD)

- 使用`keyword`类型存储标识字段

- 调整refresh_interval平衡实时性与性能

### 3.4 Kibana日志分析实战

在Kibana中高效分析容器日志:

1. 创建**Index Pattern**(fluentd-*)

2. 使用**Discover**界面进行交互式查询

3. 构建**Dashboard**可视化关键日志指标

4. 设置**Alert**规则监控异常日志

典型查询示例:

```lucene

# 查找特定命名空间的错误日志

kubernetes.namespace:production AND level:ERROR

# 统计各Pod的日志量

GROUP BY kubernetes.pod_name.keyword

```

---

## 4. 集成实践:Prometheus与EFK在容器化环境中的协同

### 4.1 Kubernetes环境部署架构

在Kubernetes集群中整合Prometheus和EFK:

```mermaid

graph LR

A[Kubelet] -->|metrics| B(Prometheus)

C[Application] -->|logs| D(Fluentd DaemonSet)

D --> E(Elasticsearch)

B --> F[Grafana]

E --> G[Kibana]

F --> H((统一监控面板))

```

### 4.2 日志与指标的关联分析

通过关联日志和指标实现根因分析:

1. **Prometheus检测异常**:例如HTTP错误率突增

2. **Kibana查询对应时间点日志**:`timestamp:[now-5m TO now] AND "500 Internal Server Error"`

3. **分析日志上下文**:定位具体错误堆栈和请求参数

### 4.3 使用Grafana统一可视化

配置Grafana同时展示指标和日志:

```yaml

# grafana.config.ini

[datasources]

prometheus.url=http://prometheus:9090

loki.url=http://loki:3100 # 可选:使用Loki替代Elasticsearch日志展示

# Dashboard示例面板:

- Graph: 服务请求率 (PromQL)

- Logs Panel: 最近错误日志 (Loki/Elasticsearch查询)

```

### 4.4 性能优化实践

大规模集群中的调优策略:

1. **Prometheus分片**:按服务/命名空间分片采集

```yaml

# prometheus-sharding.yaml

- job_name: 'serviceA'

scrape_interval: 15s

static_configs: [{targets: ['serviceA:8080']}]

- job_name: 'serviceB'

scrape_interval: 30s

static_configs: [{targets: ['serviceB:8080']}]

```

2. **Elasticsearch冷热分层**:

- 热节点:SSD存储,处理新日志

- 温节点:HDD存储,历史数据查询

3. **Fluentd缓冲区优化**:

```xml

@type file

path /var/log/fluentd-buffer

chunk_limit_size 10MB

total_limit_size 50GB

flush_interval 5s

retry_max_times 5

```

---

## 5. 总结与最佳实践

Prometheus和EFK共同构成了容器化环境**可观测性的基石**。通过本文的技术解析和实践指南,我们可以构建满足生产需求的监控日志体系。关键要点总结:

1. **监控与日志并重**:Prometheus专注指标监控,EFK处理日志分析

2. **标签驱动**:合理使用标签实现多维分析

3. **弹性设计**:随集群规模动态扩展监控日志架构

4. **安全加固**:配置RBAC、网络策略和数据加密

5. **成本控制**:设置日志保留策略和采样规则

随着云原生技术演进,Prometheus和EFK生态系统持续创新,如**OpenTelemetry**统一遥测数据采集、**eBPF**实现无侵入监控等新技术将进一步增强容器可观测性能力。建议定期评估社区新特性和优化实践,保持监控日志系统的先进性和有效性。

---

**技术标签**:

Prometheus, EFK, 容器监控, 日志管理, Kubernetes, Elasticsearch, Fluentd, Kibana, 云原生, 可观测性